Pubblicato il 8 Luglio 2025

Un impostore sfrutta l’IA per ingannare alti funzionari americani

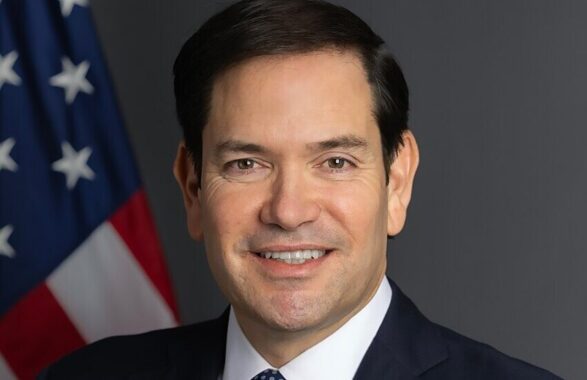

Un truffatore ha utilizzato strumenti basati su intelligenza artificiale per replicare voce e stile di comunicazione del segretario di Stato americano Marco Rubio, (nella foto d’apertura) riuscendo a ingannare diversi esponenti politici di alto profilo.

Secondo quanto riportato da un documento riservato del Dipartimento di Stato ottenuto dal Washington Post, almeno cinque alti funzionari sono stati contattati: tra questi, tre ministri degli Esteri, un governatore statunitense e un membro del Congresso. L’obiettivo dell’attacco sembrava essere l’accesso a dati sensibili o account istituzionali.

Una sofisticata truffa su Signal con voce clonata

La campagna fraudolenta ha avuto inizio a metà giugno, e si è svolta principalmente attraverso messaggi vocali e testuali inviati tramite Signal, un’app di messaggistica criptata molto usata anche durante l’amministrazione Trump.

L’impostore ha creato un account fasullo con l’indirizzo “Marco.Rubio@state.gov“ (non collegato a nessun indirizzo reale) e ha inviato messaggi vocali generati dall’IA a più destinatari. Le tecnologie di clonazione vocale hanno permesso all’attaccante di riprodurre con alta fedeltà il tono e le modalità espressive di Rubio.

Precedenti e reazioni ufficiali

Un caso simile aveva coinvolto la Casa Bianca lo scorso maggio, quando un altro impostore aveva finto di essere Susie Wiles, capo dello staff presidenziale.

A seguito di questi eventi, il Dipartimento di Stato ha avviato un’indagine interna, mentre l’FBI ha emesso un alert nazionale sulle campagne di impersonificazione con intelligenza artificiale, raccomandando di verificare sempre l’autenticità dei messaggi ricevuti da presunti funzionari.

Un problema crescente

Secondo alcuni esperti citati dal Washington Post, questi attacchi non richiedono risorse avanzate e sono resi possibili dalla mancanza di sicurezza nei canali di comunicazione utilizzati da molti rappresentanti istituzionali.

La crescente accessibilità delle tecnologie AI pone nuove sfide alla sicurezza nazionale, richiedendo misure di verifica più rigorose e una maggiore consapevolezza dei rischi digitali.